别再瞎写 go.mod 了!一行 go 1.xx,竟藏着 7 个足以颠覆你认知的“秘密开关” - Tony Bai Tony Bai 一个程序员的心路历程 Google Go语言编码风格规范 Google Go语言编码风格规范:指南篇 Google Go语言编码风格规范:决定篇 Google Go语言编码风格规范:最佳实践篇 Go语言第一课FAQ Go语言进阶课FAQ 关于我 我的技术专栏 文章列表 别再瞎写 go.mod 了!一行 go 1.xx,竟藏着 7 个足以颠覆你认知的“秘密开关” 五月 13, 2026 0 条评论 本文永久链接 – https://tonybai.com/2026/05/13/go-mod-hidden-features-7-secret-switches-in-go-version 大家好,我是Tony Bai。 在这个“CV 工程师(复制粘贴工程师)”盛行的时代,很多 Go 开发者在新建项目时,不会使用go mod init来初始化一个模块,而是会熟练地从别的 go.mod 文件里,复制粘贴那行 go 1.xx,或者直接复制一个starter 脚手架Go 工程。我们似乎都默认了go.mod中go 1.xx 的作用—— “嗯,就是声明一下我用的 Go 版本嘛,不重要。” 我们可能会花几天时间去争论 GOMAXPROCS 该设成多少,或者为了一个微小的性能优化而重构代码,但很少有人会去深究这行看似“平平无奇”的指令,到底在 Go 的世界里扮演着怎样的角色。 但如果我今天告诉你,这行被我们忽视了近 8 年的“魔法咒语”,在 Go 工具链的底层,其实悄悄地控制着多达 7 个维度 的编译和运行时行为呢? 从你能不能用泛型,到 go mod tidy 的工作模式,再到你的程序在生产环境中的默认行为……这一切,都由这行代码说了算。 最近,我扎进了 Go 语言的源码,试图去解开这个“最熟悉的陌生人”的秘密。而我发现的真相,足以颠覆多数 Gopher 的认知。 今天,就让我们来一场硬核的“源码考古”,逐一拆解这行 go 指令背后的七大用途。 go directive 是什么 go.mod 中的 go directive 格式如下: go 1.21.0 它由 golang.org/x/mod/modfile 包解析,并存储在 modfile.File….

这篇博客探讨了AI时代软件工程语言选择的转变,核心观点是传统语言(如C、Java)因复杂性和“黑魔法”特性在AI时代失效,而Go和Rust因简洁、安全性更适合AI生成与审查。作者以Eric S. Raymond(ESR)和Uncle Bob Martin(Bob大叔)为例,指出他们放弃40年C语言经验,转向Go和Rust。ESR强调AI时代代码生成与审查的新标准:AI能否高效生成代码,人类能否快速审查。Go的语法收敛、无隐式转换、直白的错误处理(如if err != nil)使其审查成本低,而Rust的内存安全机制适合生产环境。传统语言因复杂特性(如C++的宏、Java的继承)在AI生成后审查负担过高,而Go/Rust的“清晰与确定性”更符合AI时代需求。博客还指出,软件工程师角色从“写手”转向“审查员”,强调可审计性和安全性优先。总结而言,AI时代推动语言选择向简洁、安全、易审查的方向,Go和Rust成为主流选择。

codex cli 让gpt review了下CPA项目代码就封了 - 开发调优 - LINUX DO

<div id="main-outlet" class="wrap" role="main">

<!-- preload-content: -->

<div id="topic-title">

<span itemprop="itemListElement" itemscope itemtype="http://schema.org/ListItem">

<a href="/c/develop/4" class="badge-wrapper bullet" itemprop="item">

<span class='badge-category-bg' style='background-color: #32c3c3'></span>

<span class='badge-category clear-badge'>

<span class='category-name' itemprop='name'>开发调优</span>

</span...

这篇演讲由Anthropic的Fiona Fung分享,聚焦AI时代工程团队管理的变革。核心观点围绕AI工具(如Claude Code)如何重构传统工程流程,强调从“写代码慢”到“验证、协作、安全”为主的新瓶颈,以及如何通过技术调整重塑团队结构与工作方式。

1. 瓶颈转型

过去软件工程的瓶颈是“写代码慢”,现在转向验证、跨职能协作和安全。AI使代码生成成本接近零,但维护成本未降,流程需重构。传统流程(如长期路线图、评审会议)因“开发成本高”而形成,但AI时代这些流程已过时,需主动砍掉。

2. 流程重构

3. 技术辩论方式变化

从白板讨论转向代码级辩论:Claude可同时生成多个PR,对比API影响,减少无效争论。团队文化需强调协作而非个人代码所有权,避免“谁最后提交谁赢”的负面激励。

4. 代码评审自动化

Claude处理风格检查、lint、常规bug,人工保留法律合规、安全边界和产品感判断。例如,Fiona用Claude生成ASCII雪人,但设计师反馈“看起来像Mr. Peanut”,说明人工审核仍需人类审美判断。

5. 组织扁平化

6. 代码为事实来源

代码取代文档成为唯一真实来源,Claude可直接从代码回答技术问题。但需注意:若业务需文档,需将spec提交代码库,让Claude校验一致性。

7. 可观察指标

8. 未解决问题

总结

Fiona强调AI时代管理团队需主动破坏过时流程,通过技术(如Claude Code)实现流程自动化、角色扁平化,并以代码为核心。关键在于从“写代码贵”到“代码免费”的认知转变,重构团队文化与工作方式,而非单纯依赖工具提升效率。她最后建议:审视繁琐流程,问“它还在为谁服务?”。

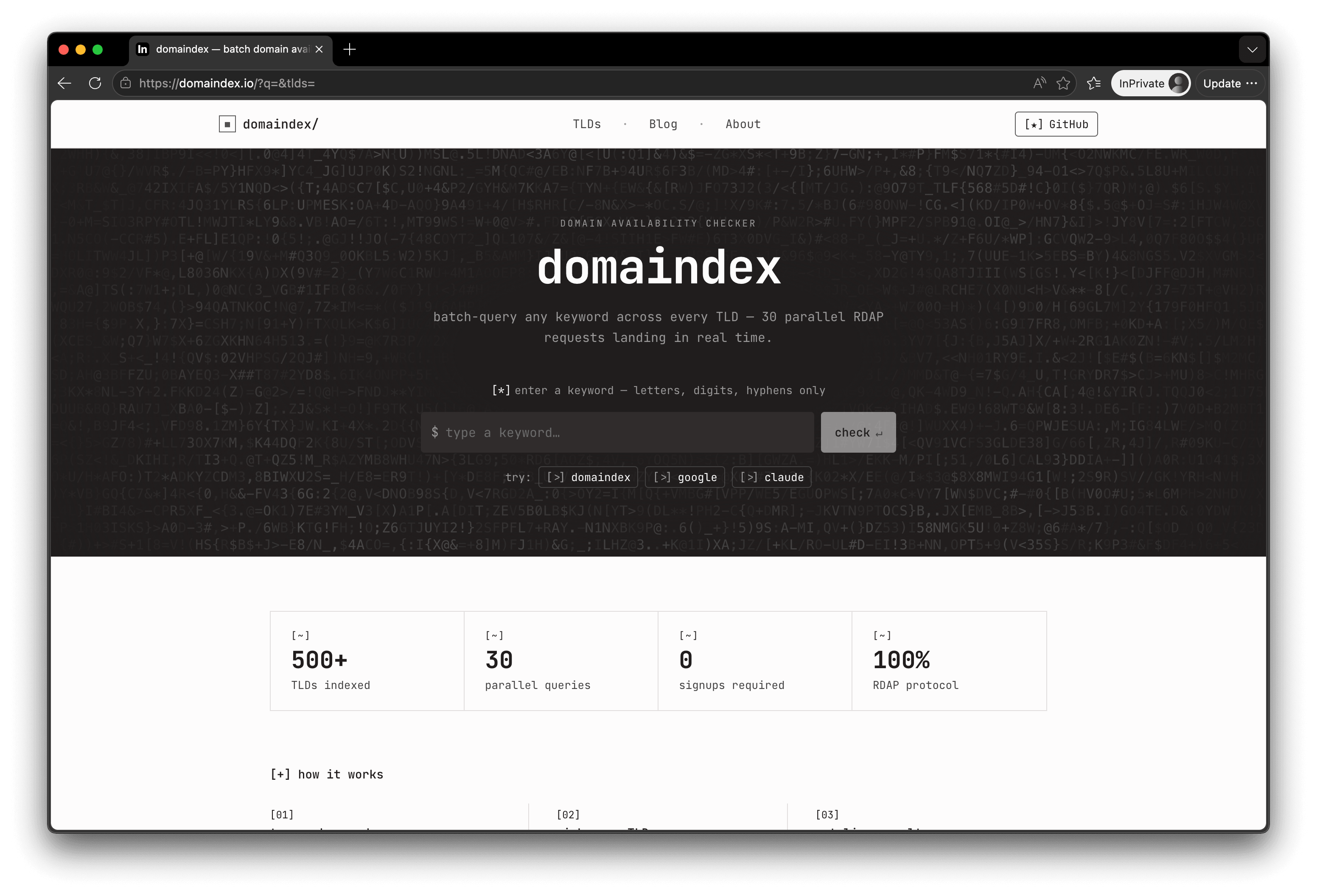

这篇博客介绍了作者开发的一个域名可用性批量查询工具——domaindex.io。作者因手动查域名耗时(需逐个尝试不同TLD如.com/.io/.ai等,且需切换注册商),因此开发了该工具以提升效率。工具的核心功能包括:

工具地址为https://domaindex.io,作者邀请用户试用,并欢迎反馈建议。该工具旨在解决域名查询的时间成本问题,尤其适合频繁需要域名的开发者或创意人士。

Release openclaw 2026.5.12-beta.6 · openclaw/openclaw · GitHub Skip to content Navigation Menu Toggle navigation Sign in Appearance settings Platform AI CODE CREATION GitHub Copilot Write better code with AI GitHub Spark Build and deploy intelligent apps GitHub Models Manage and compare prompts MCP Registry New Integrate external tools DEVELOPER WORKFLOWS Actions Automate any workflow Codespaces Instant dev environments Issues Plan and track work Code Review Manage code changes APPLICATION SECURITY GitHub Advanced Security Find and fix vulnerabilities Code security Secure your code as you build Secret protection Stop leaks before they start EXPLORE Why GitHub Documentation Blog Changelog Marketplace View all features Solutions BY COMPANY SIZE Enterprises Small and medium teams Startups Nonprofits BY USE CASE App Modernization DevSecOps DevOps CI/CD View all use cases BY INDUSTRY Healthcare Financial services Manufacturing Government View all industries View all solutions Resources EXPL…

没有赶上2个月免费team车的不用着急,大部队正在赶来 - 开发调优 - LINUX DO

<div id="main-outlet" class="wrap" role="main">

<!-- preload-content: -->

<div id="topic-title">

<span itemprop="itemListElement" itemscope itemtype="http://schema.org/ListItem">

<a href="/c/develop/4" class="badge-wrapper bullet" itemprop="item">

<span class='badge-category-bg' style='background-color: #32c3c3'></span>

<span class='badge-category clear-badge'>

<span class='category-name' itemprop='name'>开发调优</span>

</span>

</a>...

Release Release v0.54.0 · mark3labs/mcp-go · GitHub Skip to content Navigation Menu Toggle navigation Sign in Appearance settings Platform AI CODE CREATION GitHub Copilot Write better code with AI GitHub Spark Build and deploy intelligent apps GitHub Models Manage and compare prompts MCP Registry New Integrate external tools DEVELOPER WORKFLOWS Actions Automate any workflow Codespaces Instant dev environments Issues Plan and track work Code Review Manage code changes APPLICATION SECURITY GitHub Advanced Security Find and fix vulnerabilities Code security Secure your code as you build Secret protection Stop leaks before they start EXPLORE Why GitHub Documentation Blog Changelog Marketplace View all features Solutions BY COMPANY SIZE Enterprises Small and medium teams Startups Nonprofits BY USE CASE App Modernization DevSecOps DevOps CI/CD View all use cases BY INDUSTRY Healthcare Financial services Manufacturing Government View all industries View all solutions Resources EXPLORE BY TOPI…

不怕大家笑话,我到现在还是不知道怎么进入 codex - V2EX Home Sign Up Sign In • 请不要在回答技术问题时复制粘贴 AI 生成的内容 V2EX › 程序员 不怕大家笑话,我到现在还是不知道怎么进入 codex kisshere · 21 mins ago via Android · 57 views 安装完 codex ,需要电话号码验证,于是在 herosms 上充值了泰国号码和安哥拉号码,验证成功了,然后弹出错误:Token exchange failed: token endpoint returned status 403 Forbidden: Country, region, or territory not supported 抖音上那些炫 vibe coding 作品的人是不是都不是中国人? Codex 验证 错误 2 replies 1 longxinglink 2 mins ago codex 快被注册机薅死了,老外都在用 Claude ,Claude 不存在这个问题,Claude opus4.7 特别上头啊 2 Hermitist 1 min ago 还是买个电话卡吧, 比如 giffgaff 也不贵. About · Help · Advertise · Blog · API · FAQ · Solana · 2151 Online Highest 6679 · Select Language 创意工作者们的社区 World is powered by solitude VERSION: 3.9.8.5 · 86ms · UTC 00:01 · PVG 08:01 · LAX 17:01 · JFK 20:01 ♥ Do have faith in what you’re doing. ❯